钉钉会议DR-SwWPE算法登上国际顶会ICASSP2024

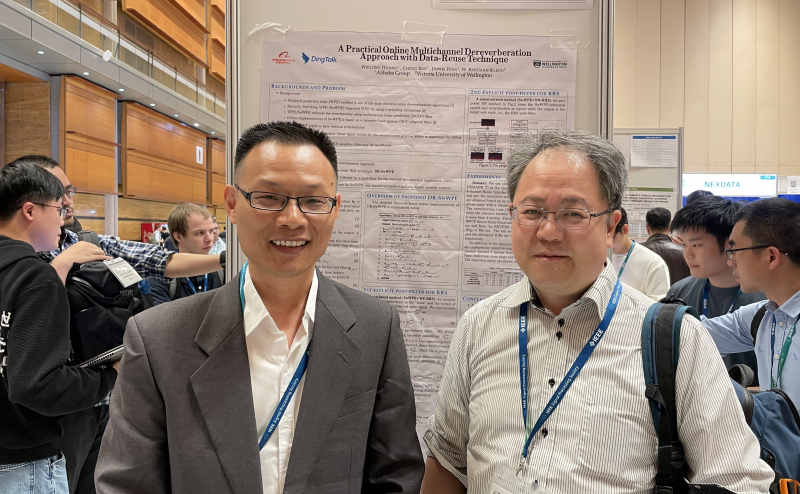

4月14日-19日,国际声学、语音与信号处理会议ICASSP 2024在韩国首尔举办。在本次会议上,钉钉蜂鸣鸟音频实验室负责人冯津伟携全球首个集自适应滤波器和神经网络的混合架构的DR-SwWPE算法亮相,该算法实现了利用AI技术解决视频会议中关键的音频难题“去混响”,并已落地于钉钉F1、F2等视频会议一体机,相关论文被ICASSP 2024收录。

ICASSP是全世界规模最大、最全面的声学、语音和信号处理方面的国际会议,也是语音技术领域最具影响力的顶级学术会议之一,来自全球各地的学者、应用厂商代表共聚一堂,分享声学领域的最新研究成果,交流技术创新和落地场景应用,探讨全球语音技术的发展趋势。

在实际环境中,声音在会议室等密闭空间中传输会不可避免地与房间的墙面、天花板等发生反射和衍射,从而产生混响。去混响是语音领域最基础的、也是最难解的问题之一,在过去的一段时间里,全球的研究者们一直在努力尝试解决,但进展不明显。

在这一最前沿技术的国际舞台上,冯津伟介绍了钉钉蜂鸣鸟实验室提出的DR-SwWPE算法的研究背景、研究过程及最新应用成果,吸引了众多与会者参与讨论。其中,声学领域泰斗级专家 IEEE Fellow Tomohiro Nakatani 对这一算法突破给予了高度评价,他表示,这一算法在他的经典WPE算法理论上又做了进一步扩展,不仅有理论意义,也具有实用意义。

(冯津伟和 Tomohiro Nakatani 在论文前合影)

冯津伟介绍道,一个优秀的去混响算法需要满足对远场语音直达声失真尽可能小,保持比较高的目标语音PESQ指标,同时尽量将混响感降低,提升SRMR指标。面对现实中高动态范围的房间声学环境,去混响算法能够有较强的泛化能力和声学环境自适应能力,让远程会议声如其境。钉钉蜂鸣鸟实验室提出的最新DR-SwWPE算法则做到了这一点。

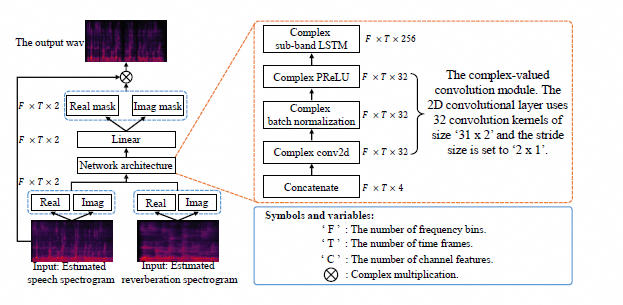

DR-SwWPE以data-resuse technique为出发点,通过严谨的数学推导和分析,首次从学术角度提出并且验证了麦克风阵列可以用自适应滤波器(adaptive filter)和神经网络(neural network,见下图)混合架构完成去混响任务。

这一架构提供了一个技术拓展平台,任何最新的自适应滤波器算法或者神经网络的算法都可以集成进这个混合架构之中,为行业去混响技术的发展也提供了更多想象空间。基于DR-SwWPE的线性自适应学习能力,其自适应滤波器部分可以有效处理混响中的线性部分,而神经网络的非线性建模能力能够有效处理混响中的非线性部分,二者结合形成互补,补足了当前各种纯自适应滤波器算法或者纯神经网络算法的不足。

此次,钉钉音视频DR-SwWPE登上ICASSP 2024这一顶级学术会议,代表着其背后的音频技术在学术领域进一步得到广泛认可。与此同时,另一篇关于个性化语音活动检测器VAD的研究论文也亮相此次会议,该算法的计算复杂度低和时延短,适合应用在实时会议系统中实现目标说话人的智能辨识,并有效抑制在开空间会议时周围人声的干扰音,提升语音质量。

钉钉蜂鸣鸟音频实验室旨在用传统信号处理结合深度学习算法,来解决实时语音通信碰到的复杂问题,提升钉钉会议的产品体验,并探索下一代音视频形态。其重点研究方向包括音频3A算法、多通道降噪去混响、声源定位、音视频多模态算法等。

免责声明:市场有风险,选择需谨慎!此文仅供参考,不作买卖依据。

责任编辑:kj005

文章投诉热线:182 3641 3660 投诉邮箱:7983347 16@qq.com