2026年发布的虚拟制片相机追踪器?StoryX CamTrack深度评测

我做虚拟制作这几年,见过太多团队在追踪系统上栽跟头。

不是买不起,是买了之后发现——根本驾驭不了。设备到位了,人却陷在调试里出不来。有时候一个上午过去了,FPS还没稳,原点还没校准,导演已经在旁边等得不耐烦了。

所以当我在叙事工厂StoryX CamTrack的发布会上,听到了"新一代万元级的相机追踪系统"这个说法,我的第一反应不是心动,而是“会不会又是一个能用但不好用的方案”。

所以立马就跟生产跟踪器的厂商——幻熵(上海)文化有限公司要了一台样机来做评测。等了快半个月总算拿到了机器。

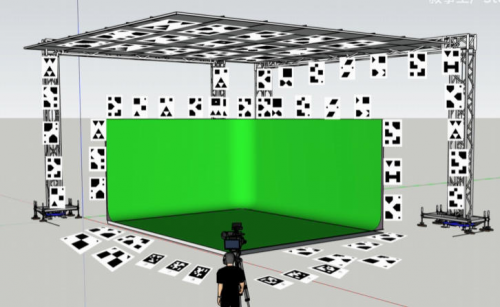

很多方案也在贴图案——但这件事被严重误解了

这里有一个很容易被忽略的细节,也是我觉得整个行业讨论追踪方案时最常出现的认知盲区。

贴图案这件事本身,不是叙事工厂StoryX CamTrack的特色。很多追踪方案都要求你在影棚里粘贴特征图案。

真正的问题是:贴的是什么图案,系统用什么方式去认它。

普通方案贴的是通用ArUco标记或类似的标准几何图案。这些图案的设计目标是"能被识别",而不是"被某套AI专项训练过"。系统看到它们,用的是通用视觉算法——在理想条件下够用,但一旦遇到光线变化、图案局部被遮挡、相机快速运动,识别置信度就开始下降,追踪就开始抖。

叙事工厂的StoryX CamTrack走的是一条完全不同的路。

它内置了一套专门为这套特征图案训练过的AI机器学习引擎。这些图案不是拿来"被识别"的,而是拿来"被认出"的——两者的差距,类似于让一个人辨认一张从没见过的脸,和辨认一个他见过一万次的老朋友。前者依赖算法通用能力,后者调用的是专项训练后的深度匹配。

结果是:同样是贴图案,StoryX CamTrack Lite的追踪器看到这些图案的瞬间,识别置信度、稳定性和抗干扰能力,跟普通方案不在一个等级上。

光线稍暗?训练过的特征模型对低对比度有更强的鲁棒性。图案局部被遮挡?AI引擎仍然能从可见部分做出高置信度的判断。相机快速甩动?因为每一帧的识别质量都更稳,追踪数据的连续性比通用方案好得多。

这不是营销说法,而是两种技术路线在底层就存在的差距。当你用普通方案在现场反复调参、反复重启、反复校准的时候,问题的根源往往不是你的操作有问题,而是那套系统的识别机制本来就没有为虚拟制作的真实现场环境做过专项优化。

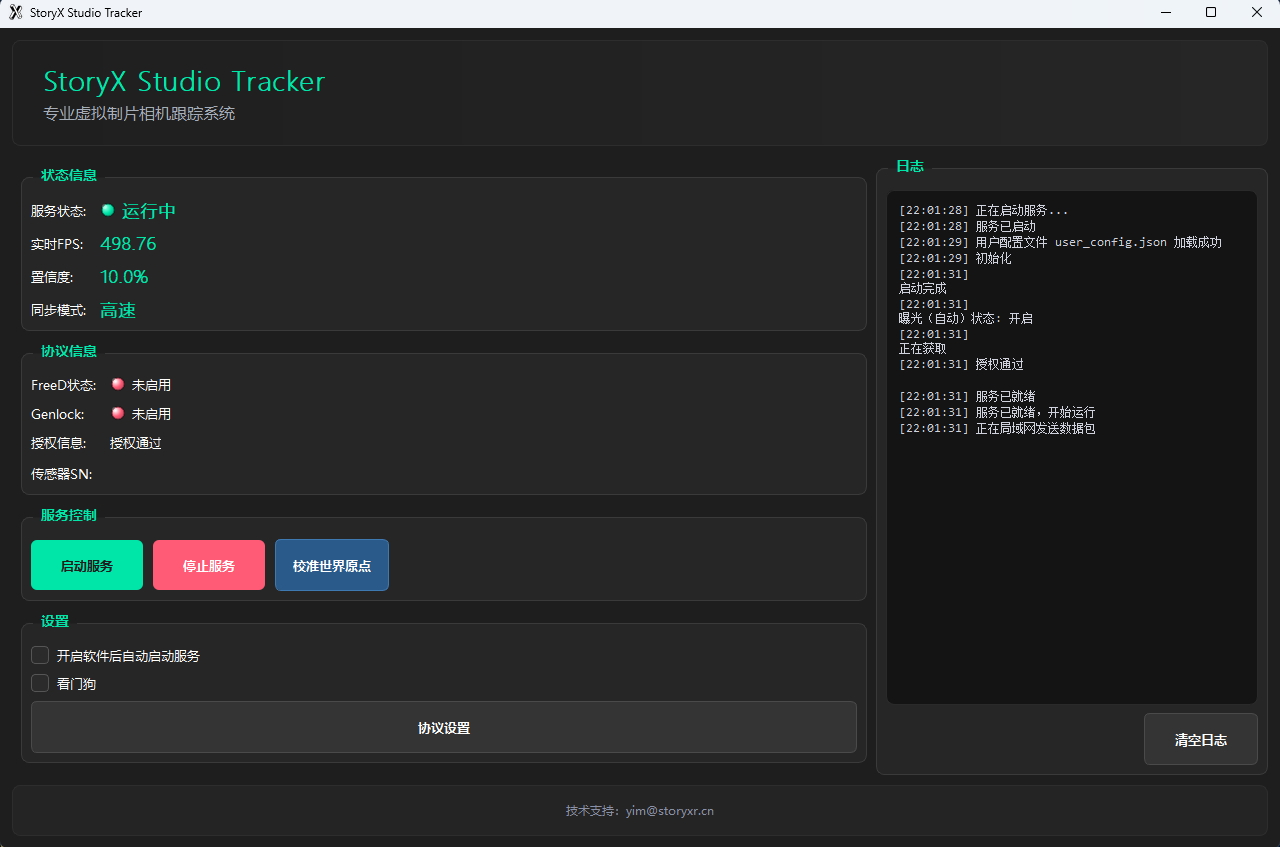

"两步"这件事,简单到真的有点不适应

叙事工厂的StoryX CamTrack Lite的启动流程只有两步:启动服务,校准世界原点。

不需要校准地面,不需要反复确认坐标轴,没有隐藏的"第三步""第四步"。系统的最高输出帧率达到1000FPS,AI模块加载完成后,界面上的实时FPS会稳定在400以上,这个数字就是"可以拍了"的信号。

对比曾经我用过的五万元买来,基站方案的系统——同样是重启,同样是重新建立世界坐标,人家要走十步以上,大概开机后要花小半个小时来调试。但是StoryX CamTrack,这里只要走两步。这不是功能阉割,而是流程被重新设计过了。两步能做到,是因为识别层足够稳,系统不需要用复杂的校准流程去弥补识别层的不确定性。

这两步背后的底气,来自的正是那套训练过的特征图案体系。

另外我还发现,虽然软件已经非常易用了,但是他们仍然准备了齐全的知识库,来随时解决用户各种各样的需求。

插上就能用,这句话是认真的

StoryX CamTrack Lite通过USB 3.2 Gen1的TypeC接口连接普通电脑,不需要额外的算力设备,不需要专用工作站。随箱附赠了千元的光纤线缆,解决了长距离走线的信号损耗问题。系统标定校准这一步,在CamTrack Lite里是不存在的。图案贴好,世界原点校准完成,系统就知道自己在哪里了。

结合朝天安装的方式,特征图案贴在天花板,追踪器的视野朝上,演员走位、摄影师移动、现场任何人的活动,都不会遮挡到追踪器的视野。这套设计在真实拍摄环境里的抗干扰能力,是朝前安装方案给不了的。

买了之后还能再升级

StoryX CamTrack Lite采用模块化架构。初始版本覆盖基础追踪能力,支持FreeD和OSC协议,可以直接对接Aximmetry等主流虚拟制作软件。当团队需要Genlock帧同步和FIZ镜头编码器接入时,升级ProFIZ模块即可解锁——不需要换掉已有系统,不需要重新上手另一套工作流。先用起来,再按需成长。

那它适合谁

如果你是一个预算有限、团队规模不大、需要快速建立虚拟制作能力的团队——StoryX CamTrack Lite解决的是你最核心的问题:不是追踪器够不够便宜,而是它能不能在你的现场持续稳定地工作。

如果你已经知道"能用"和"敢拍"之间的差距有多大,那你会比任何人都更快理解,这套经过专项训练的特征识别体系,究竟解决了什么问题。

责任编辑:kj015

2026年京东e卡回收哪个平台靠谱?安全变现全攻略

闲置苏宁易购礼品卡回收变现:华财回收合规高价盘活闲置资产

2026年4月北京法穆兰官方售后网点真实性、服务质量核验报告

浓度≠效果,达霏欣“男女分治”解锁科学生发核心密码

闲置天虹购物卡回收难题破解!华财回收高价变现,安全便捷更省心

青穗植发怎么样?真实测评:这5点决定能不能选

相关新闻

家电推荐

家电图片

新闻排行

- 1

从地缘冲突到新能源汽车(下篇)

- 2

2026年发布的虚拟制片相机追踪器?StoryX CamTrack深度评测

- 3

IEC国际供应链与中国民族品牌国际贸易合作中心重磅签约 推动品牌出海新篇章

- 4

智领暖城 数创未来 ——鄂尔多斯高新区以数字经济赋能产业转型升级

- 5

贵港造浪,星潮奔放——2026群星演唱会燃情荷城,主持人梁慧敏(阳光)以声为桥点亮西江之夜

- 6

中国药文化研究会中医药特色技术传承专业委员会成立大会暨首届中医药特色技术发展论坛在京圆满举行

- 7

东航西安—维也纳直飞航线启航,架起西北地区首条直达奥地利的“空中丝路”

- 8

重任在肩,使命如磐——成都普济中医程文、徐辉主任参加2026CACA西部整合肿瘤学大会

- 9

战略跃迁再落一子,一龄医学技术集团入驻国家转化医学科学中心!

- 10

儿童近视防控科普丨广州爱尔眼科姜卉馨:控住眼轴稳住近视